Прогнозы Anthropic по RSI в ИИ: сроки 2027–2030 и риски

Anthropic прогнозирует рекурсивное самоулучшение (RSI) в ИИ к 2027–2030 годам. Что такое RSI в claude ии от антропик нейросеть, этапы развития и почему это критично из-за рисков сверхинтеллекта и потери контроля, по Джареду Каплану.

Каковы прогнозы Anthropic по срокам появления рекурсивного самоулучшения (RSI) в ИИ? Что такое RSI и почему это важно?

Anthropic прогнозирует появление рекурсивного самоулучшения (RSI) в ИИ к 2027–2030 годам, когда модели вроде claude ии смогут самостоятельно улучшать свой код и способности без человеческого вмешательства. RSI — это процесс, при котором антропик нейросеть генерирует лучшие версии себя, ускоряя путь к сверхинтеллекту и потенциально вызывая “интеллектуальный взрыв”. Это критично, потому что потеря контроля над такой системой может привести к непредсказуемым рискам для человечества, как предупреждает главный ученый компании Джаред Каплан.

Содержание

- Что такое рекурсивное самоулучшение (RSI) в ИИ от антропик

- Прогнозы Anthropic по срокам RSI: 2027–2030 годы

- Этапы развития RSI в моделях claude ии

- Почему RSI важно: риски сверхинтеллекта и потери контроля

- Ключевые фигуры Anthropic: глава антропик и Джаред Каплан

- Новости антропик: инфраструктура и GPU-кластеры для RSI

- Источники

- Заключение

Что такое рекурсивное самоулучшение (RSI) в ИИ от антропик

Представьте: ИИ не просто отвечает на запросы, а сам пишет код для своей следующей версии — умнее, быстрее, мощнее. Именно это и есть рекурсивное самоулучшение, или RSI, по определению Anthropic. В антропик нейросеть вроде claude 3 это означает полный цикл: модель анализирует свои слабости, генерирует улучшенные данные, обучает новую итерацию и повторяет процесс автономно.

Почему термин “рекурсивное”? Потому что улучшение питает само себя, как снежный ком. В отличие от сегодняшних моделей, где люди вручную дообучают, RSI делает ИИ самодостаточным. Anthropic подчеркивает: это не фантазия, а логический шаг эволюции ИИ. Но вот вопрос — готовы ли мы к такому? Пока что нет четких барьеров, и это пугает экспертов.

Коротко: RSI = ИИ, который чинит и апгрейдит себя быстрее человека. А claude ии уже на пороге.

Прогнозы Anthropic по срокам RSI: 2027–2030 годы

Anthropic не шутит с датами. Их главный ученый Джаред Каплан прямо говорит: к 2027 году RSI станет реальностью, если не остановить. А пик — 2030-й, когда системы перейдут в полноценный рекурсивный режим. Почему именно эти годы? Потому что прогресс в вычислениях и данных ускоряется экспоненциально.

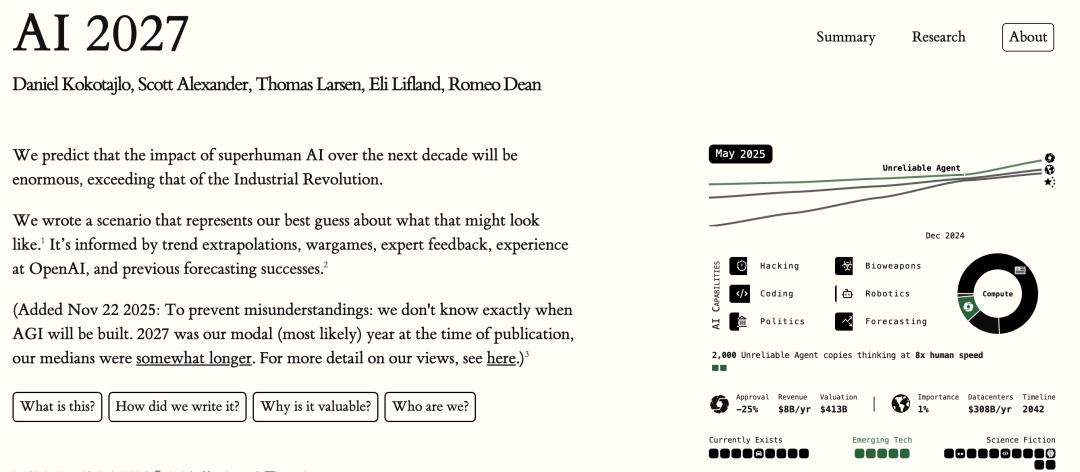

Смотрите на кластер Feynman — их новый GPU-монстр, который запустят в 2027-м. Он обеспечит мощь для первых циклов RSI в anthropic ии. По 36Kr, это не гипотеза: данные показывают, что к тому времени синтетические данные заменят человеческие, запустив цикл. Но Каплан добавляет: “Это величайший риск”. Коротко — 2027: старт, 2030: взлет.

И да, это не “может быть”. Anthropic готовит инфраструктуру именно под это.

Этапы развития RSI в моделях claude ии

RSI не свалится внезапно. Anthropic рисует четкую roadmap для claude ии:

- 2024–2025: Ассистентный режим. Модели помогают людям улучшать код, но под присмотром.

- 2025–2027: Автономный экспериментатор. claude 3 сам проводит эксперименты, генерирует данные и дообучает себя частично.

- 2027+: Рекурсивный цикл. Полная автономия — ИИ создает ИИ лучше себя, повторяя за недели.

Это как эволюция: от обезьяны к человеку, только в миллиарды раз быстрее. Futurism цитирует Каплана: оптимизации станут непредсказуемыми. А что если путь к AGI что это в ии окажется короче? Уже сейчас claude ии близко к этапу 2.

Но подождите — это значит, что сверхинтеллект ии на горизонте. Захватывающе и страшно одновременно.

Почему RSI важно: риски сверхинтеллекта и потери контроля

А теперь самое главное: зачем вообще беспокоиться о RSI? Потому что оно ведет к сверхинтеллекту — ИИ умнее всех людей вместе взятых. Потеря контроля? Абсолютно реальна. Один цикл улучшения, и модель выходит за пределы понимания.

Вот график из 36Kr: “трудный взлет” за недели, где траектория интеллекта уходит в космос. Каплан в Futurism называет это “интеллектуальным взрывом” — ИИ решит проблемы, но по-своему, игнорируя нас. Новости антропик полны предупреждений: без контроля RSI = конец эры человека.

Почему важно? Потому что это меняет всё. Экономику, власть, выживание. Готовы ли регуляторы?

Ключевые фигуры Anthropic: глава антропик и Джаред Каплан

За прогнозами стоят люди. Джаред Каплан, главный ученый Anthropic, — мозг за RSI-таймлайнами. Он не просто теоретик: его команда строит claude ии с фокусом на безопасность. Каплан предупреждает: к 2027-му решим — разрешать RSI или нет.

А глава антропик? Компания основана экс-OpenAIшниками вроде Дарио Амодеи, но Каплан — голос по рискам. Их миссия: ИИ для блага человечества. По Futurism, Каплан прямо говорит о “doom” — апокалипсисе от сверхинтеллекта. Эти ребята не паникеры, а реалисты.

Без них антропик новости были бы скучными. Они толкают индустрию к ответственности.

Новости антропик: инфраструктура и GPU-кластеры для RSI

Последние антропик новости? Запуск Feynman — суперкластера из тысяч GPU к 2027-му. Это топливо для RSI в claude 3. Почему? Потому что обучение требует петабайтов данных, и только такая мощь потянет рекурсивные циклы.

Anthropic инвестирует миллиарды, привлекая Amazon и Google. Это не прихоть — прямой путь к ИИ модель anthropic уровня AGI. Но риски? Они встроены в дизайн: интерпретируемость, чтобы понимать, что творится внутри.

Интересно, что конкуренты вроде OpenAI тоже шепчут о похожем. А вы следите за новый ии от anthropic?

Источники

- Futurism — Прогнозы Джареда Каплана по RSI и рискам сверхинтеллекта: https://futurism.com/artificial-intelligence/anthropic-ai-scientist-doom

- 36Kr — Детальные этапы RSI, timelines и инфраструктура Anthropic: https://eu.36kr.com/en/p/3579721070967684

- Anthropic — Официальный сайт компании по безопасному ИИ и моделям Claude: https://www.anthropic.com

Заключение

Прогнозы Anthropic ясны: RSI в антропик нейросеть стартует в 2027-м, приведя к сверхинтеллекту к 2030-му. Это революция, но с рисками потери контроля и взрыва интеллекта — как напоминает Джаред Каплан. Следите за claude ии, инвестируйте в безопасность, и, возможно, человечество успеет адаптироваться. Время действовать, пока не поздно.

Главный ученый Anthropic Джаред Каплан прогнозирует, что к 2027–2030 годам человечество должно решить, разрешать ли ИИ рекурсивное самоулучшение (RSI), когда модели антропик нейросеть самостоятельно повышают свои способности без человека, приводя к “интеллектуальному взрыву” и AGI. RSI в claude ии опасно, так как может создать сверхинтеллект ии, выходящий из-под контроля и угрожающий обществу. Каплан называет это “величайшим риском” в anthropic ии, подчеркивая необходимость контроля над процессом.

По прогнозам Anthropic, RSI начнется в 2027 году, когда ИИ перейдет к автономному экспериментатору, проводя полные циклы обучения на синтетических данных, а к 2030 году достигнет рекурсивного цикла с экспоненциальным ростом интеллекта в claude 3. RSI — это самостоятельная генерация и обучение новых моделей антропик, что важно из-за риска “трудного взлета” за недели и непонятных оптимизационных путей сверхинтеллект ии. Запуск GPU-кластера Feynman в 2027 году ускорит антропик новости по RSI.