Запреты OpenAI: Гарантии безопасности данных для правительств

Риски запретов OpenAI в странах из-за опасений национальной безопасности. Гарантии безопасности данных, необходимые правительствам для доверия иностранным ИИ-компаниям.

Может ли OpenAI столкнуться с запретами в некоторых странах из-за опасений национальной безопасности? Какие гарантии нужны правительствам, чтобы доверять обработку данных граждан иностранной ИИ-компанией, особенно после партнерства с Dow?

OpenAI действительно может столкнуться с запретами в некоторых странах из-за опасений национальной безопасности, особенно если их технологии используются для сбора или обработки чувствительных данных. Правительствам необходимы строгие гарантии безопасности данных граждан, включая прозрачность алгоритмов, независимый аудит и гарантии отсутствия скрытых бэкдоров, особенно после партнерства с крупными корпорациями типа Dow, что может усилить недоверие иностранных регуляторов к защите суверенных данных.

Содержание

- Риски для OpenAI: Возможные запреты из-за опасений национальной безопасности

- Гарантии для правительств: Требования к безопасности данных граждан

- Европейский подход: AI Act как пример регулирования ИИ-компаний

- Стандарты NIST: Рамки управления рисками для иностранных ИИ-сервисов

- Партнерство с Dow: Потенциальные последствия для национальной безопасности

- Будущее регулирования: Тренды в контроле иностранных ИИ-компаний

Риски для OpenAI: Возможные запреты из-за опасений национальной безопасности

OpenAI действительно сталкивается с растущими рисками ограничений в различных странах из-за опасений национальной безопасности. Эти опасения возникают по нескольким ключевым причинам. Во-первых, способность ИИ-моделей обрабатывать большие объемы данных и выявлять закономерности может представлять угрозу для государственных секретов. Во-вторых, потенциальное использование технологий OpenAI для дезинформации или манипулирования общественным мнением вызывает у правительств серьезные опасения.

Китай уже ввел ограничения на использование зарубежных ИИ-моделей, требуя от местных компаний получать специальное разрешение на их импорт. Иран запретил ChatGPT из-за опасений, что технология может использоваться для распространения “западных идей”. Другие страны рассматривают аналогичные меры. Почему это так важно? Потому что национальная безопасность сегодня включает не только военные аспекты, но и защиту информационного суверенитета.

Особенно тревожными для правительств становятся вопросы контроля над данными. Когда иностранная компания обрабатывает информацию о гражданах страны, возникает потенциальная возможность утечки или злоупотребления этими данными. Это особенно актуально для секторов здравоохранения, финансов и государственной безопасности, где точные данные могут использоваться для компрометации национальных интересов.

Гарантии для правительств: Требования к безопасности данных граждан

Правительствам необходимы комплексные гарантии безопасности данных граждан, чтобы доверять иностранным ИИ-компаниям. Эти гарантии выходят далеко за рамки стандартных соглашений о конфиденциальности и включают технические, операционные и юридические механизмы защиты данных. Без таких гарантий страны будут продолжать вводить ограничения и запреты на использование зарубежных ИИ-сервисов.

Технические гарантии включают требование к прозрачности алгоритмов и доступности исходного кода для независимой проверки. Почему это критически важно? Потому что без понимания того, как работает система, невозможно гарантировать отсутствие скрытых функций, которые могут использоваться для сбора данных или манипуляции. Правительства также требуют локализации обработки данных — информация о гражданах страны должна обрабатываться на серверах, расположенных на территории этой страны.

Операционные гарантии подразумевают регулярные независимые аудиты безопасности и возможность временного отключения сервиса в случае возникновения угрозы национальной безопасности. Это дает правительствам контроль над ситуацией и возможность быстро реагировать на инциденты. Кроме того, требуются четкие протоколы реагирования на инциденты безопасности с обязательным уведомлением регуляторов в течение строго определенных сроков.

Юридические гарантии включают создание международных соглашений о взаимном сотрудничестве в области кибербезопасности и механизмами разрешения споров. Особенно важным становится требование к судебной подведомственности — споры о защите данных должны разрешаться в судах страны, граждане которой являются субъектами этих данных. Это снижает риски и повышает уровень доверия к иностранным ИИ-компаниям.

Европейский подход: AI Act как пример регулирования ИИ-компаний

Европейский Союз внедрил AI Act (Регламент (ЕС) 2024/1689) — первый в мире комплексный правовой фреймворк для регулирования искусственного интеллекта. Этот закон устанавливает риск-ориентированный подход с четырьмя уровнями риска: неприемлемый, высокий, прозрачности и минимальный/отсутствие риска. Европейская комиссия разработала этот закон как ответ на растущие опасения в области безопасности данных и национальной безопасности.

Иностранные ИИ-компании, такие как OpenAI, могут столкнуться с серьезными ограничениями, если их системы попадают в категорию высокого риска или неприемлемого риска. К неприемлемым рискам относятся социальный скоринг и нецелевой сбор данных для распознавания лиц — практики, которые прямо запрещены в ЕС. Почему это важно? Потому что такие системы могут использоваться для массовой слежки за гражданами, что нарушает базовые права на частную жизнь.

Для работы в ЕС компании должны соблюдать строгие обязательства: оценку рисков, высокое качество данных, логирование действий, подробную документацию и человеческий контроль. Генеративные ИИ-модели, такие как ChatGPT, должны обеспечивать прозрачность, маркировать ИИ-контент и соблюдать авторские права. Особенно важно требование к информированию пользователей о том, что они взаимодействуют с ИИ, а не с человеком.

Европейский подход создает прецедент для других стран. После внедрения AI Act правительства других стран начали разрабатывать аналогичные законодательства. Это создает глобальный тренд toward более строгому регулированию иностранных ИИ-компаний. Для OpenAI и других игроков рынка означает необходимость адаптации бизнес-моделей под разные юрисдикции, что может значительно увеличить операционные расходы.

Стандарты NIST: Рамки управления рисками для иностранных ИИ-сервисов

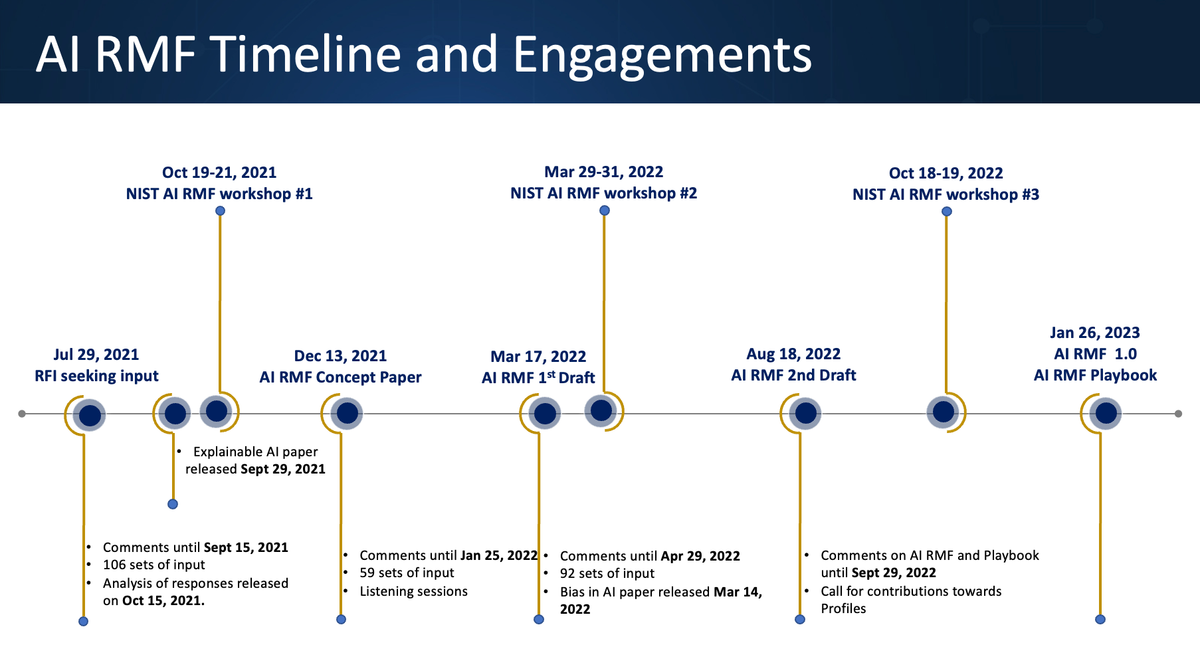

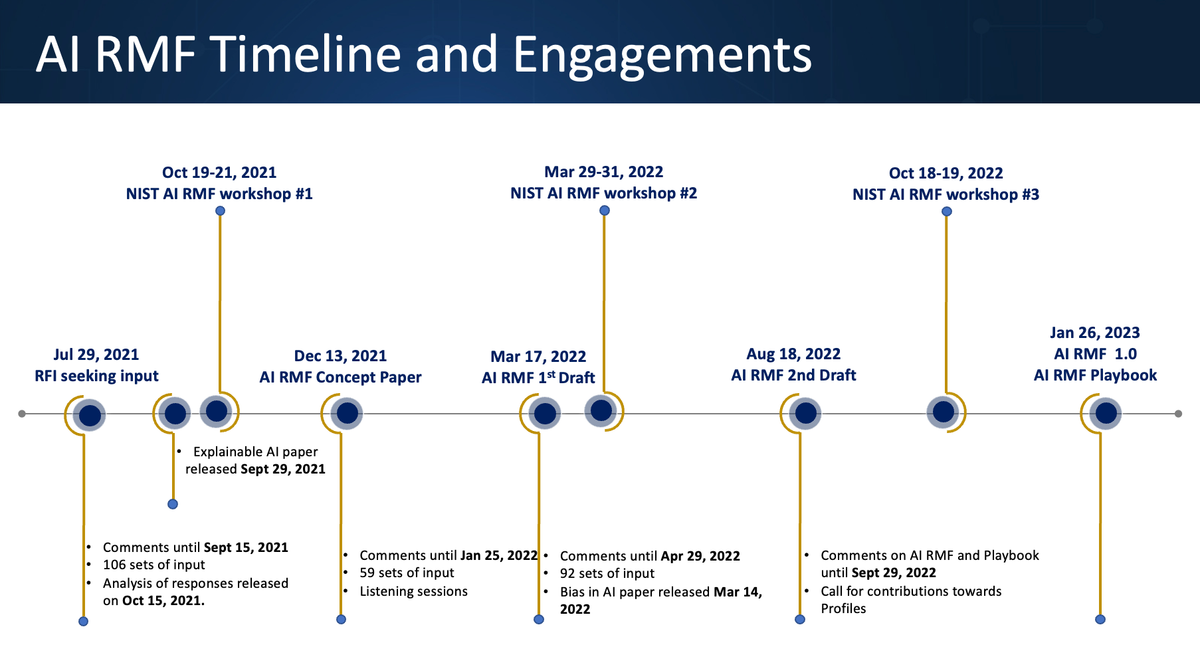

Национальный институт стандартов и технологий (NIST) разработал Рамочную структуру управления рисками ИИ (AI RMF), выпущенную 26 января 2023 года. NIST предоставляет руководство по управлению рисками, связанными с искусственным интеллектом, включая вопросы национальной безопасности и защиты данных. Хотя документ не упоминает OpenAI напрямую, он предлагает всеобъемлющий подход к оценке и смягчению рисков ИИ.

Рамка NIST основана на четырех ключевых функциях: Govern (управление), Map (сопоставление), Measure (измерение) и Manage (управление). Эта структура помогает правительствам и компаниям систематически подходить к оценке рисков, связанных с ИИ-системами. Особенно важной является функция Map, которая требует выявления и документирования всех данных, используемых ИИ-системой, и потенциальных сценариев ее использования.

Правительствам могут потребоваться гарантии, включая прозрачные процессы управления данными, строгие меры безопасности и четкие структуры подотчетности от иностранных ИИ-компаний. В июле 2024 года NIST выпустил профиль для генеративного ИИ (NIST-AI-600-1), который помогает организациям идентифицировать уникальные риски, связанные с генеративными ИИ-технологиями. Этот профиль включает специфические рекомендации по оценке рисков для больших языковых моделей.

Стандарты NIST становятся де-факто основой для регулирования ИИ во многих странах. Их основное преимущество — гибкость. В отличие от жестких законодательных актов, рамки NIST предлагают руководство, которое можно адаптировать под конкретные нужды каждой страны или отрасли. Это снижает барьеры для внедрения и позволяет governments gradually вводить требования к безопасности данных.

Партнерство с Dow: Потенциальные последствия для национальной безопасности

Партнерство OpenAI с Dow Chemical создает дополнительные риски для национальной безопасности, особенно в промышленном шпионаже и технологическом суверенитете. Почему это вызывает особые опасения? Потому что Dow работает в стратегически важных отраслях, включая химическую промышленность, фармацевтику и материалы, где данные о процессах и исследованиях могут представлять огромную коммерческую и военную ценность.

Для правительств таких стран, как Китай, Россия или Индия, сотрудничество американской ИИ-компании с американской промышленной корпорацией может восприниматься как угроза технологической независимости. Особенно тревожным становится потенциальный доступ Dow к уникальным паттернам и инсайтам, извлеченным из промышленных данных, которые могут использоваться для конкурентного преимущества или даже для компрометации национальных технологий.

Правительства могут потребовать от OpenAI дополнительных гарантий в таких случаях:

- Полная изоляция данных от стратегически важных отраслей

- Запрет на использование данных для обучения моделей без явного согласия владельцев

- Создание “чистых” версий моделей, обработанных без доступа к промышленным данным

- Регулярные независимые аудиты для подтверждения отсутствия утечек данных

Эти требования особенно актуальны для стран, активно развивающих собственную промышленную базу. Для OpenAI означает необходимость создания сложной системы сегментации данных, что может значительно увеличить операционные затраты и снизить эффективность моделей. Однако без таких гарантий компании рискуют потерять доступ к целым рынкам из-за опасений национальной безопасности.

Будущее регулирования: Тренды в контроле иностранных ИИ-компаний

Будущее регулирования иностранных ИИ-компаний будет характеризоваться усилением требований к безопасности данных и созданием региональных экосистем ИИ. Этот тренд уже прослеживается в законодательстве ЕС, КНР и других стран, которые стремятся создать собственные “песочницы” для ИИ-разработок. Почему это важно? Потому что это означает глобальную фрагментацию рынка ИИ, где иностранные компании будут вынуждены адаптироваться под разные регуляторные среды.

Один из ключевых трендов — требование к локализации данных и вычислений. Правительства все чаще настаивают на том, чтобы данные о гражданах страны обрабатывались на серверах, расположенных на территории этой страны. Это снижает риски утечек и дает регуляторам больший контроль над процессом. Для OpenAI означает необходимость создания региональных центров обработки данных, что значительно увеличивает операционные расходы.

Другой важный тренд — создание международных стандартов безопасности данных. Организации типа NIST и ITU (Международный союз электросвязи) разрабатывают фреймворки, которые могут стать основой для глобальных соглашений об обмене данными и сотрудничестве в области кибербезопасности. Эти стандарты помогут создать единые требования к безопасности данных граждан, снижая барьеры для иностранных ИИ-компаний.

Наконец, мы видим рост требований к прозрачности алгоритмов. Правительства все настойчивее требуют от ИИ-компаний предоставления информации о том, как работают их системы, какие данные используются и как принимаются решения. Это особенно важно для систем, влияющих на жизнь граждан — от кредитного скоринга до медицинского диагноза. Без такой прозрачности правительства будут продолжать вводить ограничения на использование иностранных ИИ-сервисов.

Источники

- AI Act — Регулирование ИИ в ЕС — Первый в мире комплексный правовой фреймворк для регулирования искусственного интеллекта: https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

- NIST AI Risk Management Framework — Рамки управления рисками ИИ для оценки и смягчения угроз безопасности данных: https://www.nist.gov/itl/ai-risk-management-framework

Заключение

OpenAI действительно может столкнуться с запретами в некоторых странах из-за опасений национальной безопасности, особенно если их технологии не соответствуют растущим требованиям к защите данных граждан. Ключевыми гарантиями для правительств становятся прозрачность алгоритмов, локализация данных, независимые аудиты и четкие механизмы подотчетности. Партнерство с крупными корпорациями типа Dow только усиливает эти опасения, требуя дополнительных мер защиты стратегических данных.

Будущее регулирования указывает на глобальную фрагментацию рынка ИИ, где компании будут вынуждены адаптироваться под разные регуляторные среды. Для OpenAI и других иностранных игроков рынка означает необходимость значительных инвестиций в безопасность данных и создание региональных центров обработки. Однако без таких гарантий компания рискует потерять доступ к целым рынкам, где национальная безопасность и защита суверенных данных ставятся выше технологического прогресса.

Европейский Союз внедрил AI Act (Регламент (ЕС) 2024/1689) — первый в мире комплексный правовой框架 для регулирования искусственного интеллекта. Этот закон устанавливает риск-ориентированный подход с четырьмя уровнями риска: неприемлемый, высокий, прозрачности и минимальный/отсутствие риска. Иностранные ИИ-компании, такие как OpenAI, могут столкнуться с ограничениями, если их системы попадают в категорию высокого риска или неприемлемого риска, включая запрет на социальный скоринг и нецелевое сбор данных для распознавания лиц. Для работы в ЕС компании должны соблюдать строгие обязательства: оценку рисков, высокое качество данных, логирование действий, подробную документацию и человеческий контроль. Генеративные ИИ-модели должны обеспечивать прозрачность, маркировать ИИ-контент и соблюдать авторские права.

NIST разработал Рамочную структуру управления рисками ИИ (AI RMF), выпущенную 26 января 2023 года, которая предоставляет руководство по управлению рисками, связанными с искусственным интеллектом. Хотя документ не упоминает OpenAI напрямую, он предлагает всеобъемлющий подход к оценке и смягчению рисков ИИ, включая вопросы национальной безопасности и защиты данных. В июле 2024 года NIST выпустил профиль для генеративного ИИ (NIST-AI-600-1), который помогает организациям идентифицировать уникальные риски, связанные с генеративными ИИ-технологиями. Правительствам могут потребоваться гарантии, включая прозрачные процессы управления данными, строгие меры безопасности и четкие структуры подотчетности от иностранных ИИ-компаний.